Einführung

In unserem vorherigen Artikel haben wir NetApp Storage und NVMe-oF für bahnbrechende Leistung in Proxmox-Virtualisierungsumgebungen vorgestellt. Dieser Artikel führte LVM mit NVMe-oF über TCP im NetApp-Speicher mit Proxmox VE ein und hob dessen Potenzial hervor, eine hochleistungsfähige Speicherlösung bereitzustellen, die für latenzempfindliche Anwendungen wie virtualisierte Datenserver geeignet ist. Und es funktioniert über ein Ethernet-Netzwerk ohne andere spezielle Hardware wie Fibre Channel oder InfiniBand, die für viele Unternehmen unerschwinglich sein können.

Während NVMe-oF erhebliche Leistungsvorteile bietet, wird es hauptsächlich auf neueren und High-End NetApp ONTAP Speichersystemen, wie der AFF-Serie, unterstützt. Für Unternehmen mit älteren oder hybriden Speichersystemen bleibt iSCSI eine praktikable und kostengünstige Alternative, die die bestehende Ethernet-Infrastruktur nutzt und zuverlässige Leistung für Virtualisierungsumgebungen bietet.

In diesem Blogbeitrag werden wir die Verwendung von iSCSI (Internet Small Computer Systems Interface) im NetApp-Speicher mit Proxmox VE näher beleuchten.

Einrichtung

In diesem Beispiel verwendete Hard- und Software

- NetApp Speichersystem: Bietet gemeinsame Speicherfunktionen, die für das Clustering in virtuellen Umgebungen über iSCSI unerlässlich sind. Das Beispiel verwendet ONTAP Release 9.15.1.

- Proxmox VE Cluster: Eine open source Virtualisierungsplattform. Das Beispiel verwendet die aktuelle Version 8.2.

- Netzwerkinfrastruktur: Standard-Ethernet-Netzwerk (1GbE oder 10GbE).

- iSCSI-Initiator: In Proxmox VE integriert.

Was ist iSCSI

iSCSI (Internet Small Computer Systems Interface) ist ein Netzwerkprotokoll, das den Transport von Block-Level-Speicherdaten über IP-Netzwerke (Internet Protocol) ermöglicht. Das Protokoll erlaubt es Clients (genannt Initiatoren), SCSI-Befehle über TCP/IP an Speichergeräte (Ziele) auf entfernten Servern zu senden. Es ermöglicht die Verbindung von Speichergeräten über eine Standard-Netzwerkinfrastruktur, ohne spezielle Hardware und Verkabelung zu benötigen.

Es bietet eine flexible, kostengünstige und skalierbare Speicherlösung, die sich gut in Virtualisierungsumgebungen integrieren lässt und die notwendigen Funktionen und Leistung zur Unterstützung moderner virtualisierter Workloads bereitstellt.

Wie iSCSI funktioniert

- Initiator und Target: Die iSCSI-Kommunikation umfasst zwei Hauptkomponenten:

- Initiator: Die clientseitige Komponente, typischerweise ein Server oder Host, die die Verbindung zum Speichergerät initiiert.

- Target: Die serverseitige Komponente, typischerweise ein Speicher-Array oder -Gerät, das den Zugriff auf die Speicherressourcen bereitstellt.

- LUNs (Logical Unit Numbers): Speicherressourcen auf dem iSCSI-Target werden als LUNs dargestellt. Der Initiator greift auf diese LUNs zu, als wären sie lokale Festplatten, wodurch das Betriebssystem sie wie jedes andere Block-Speichergerät formatieren, partitionieren und verwenden kann.

Konfiguration

Auf NetApp-Speicher

Der Leitfaden geht davon aus, dass Benutzer die grundlegende Speichereinrichtung, einschließlich der Konfiguration von Storage Virtual Machines (SVMs), bereits vorgenommen haben. Es wird betont, dass die Verwaltung dieser Systeme dank der intuitiven Weboberfläche – dem ONTAP System Manager, der von NetApp Speichersystemen bereitgestellt wird – relativ unkompliziert ist. Benutzer können eine benutzerfreundliche Erfahrung bei der Verwaltung ihrer Speicherlösungen erwarten, da die Weboberfläche darauf ausgelegt ist, komplexe Aufgaben zu vereinfachen. Dies beinhaltet auch die gesamte Einrichtung für iSCSI-Speicher, die das allgemeine Aktivieren von iSCSI auf der SVM, das Einrichten der SAN Initiatorgruppe und deren Zuordnung zu LUNs erfordert.

Hinweis: Alle Änderungen können selbstverständlich auch automatisiert durch Orchestrierung der ONTAP API vorgenommen werden.

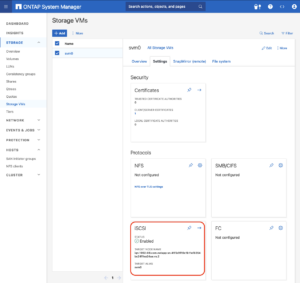

iSCSI-Target auf SVM aktivieren

Um iSCSI auf SVM-Ebene in einem NetApp Speichersystem zu aktivieren, können typischerweise die folgenden zusammengefassten Schritte ausgeführt werden, die über die Weboberfläche des Systems, den ONTAP System Manager, zugänglich sind.

Navigieren Sie zum Menü Storage. Navigieren Sie dann zu Storage VMs. Geben Sie den SVM-Namen an, den Sie konfigurieren möchten:

- iSCSI-Protokoll konfigurieren: Suchen Sie innerhalb der SVM-Einstellungen nach einem Abschnitt oder Tab, der sich auf Proto

kolle bezieht. Suchen Sie die iSCSI-Option und aktivieren Sie sie. Dies kann das Ankreuzen eines Kästchens oder das Umschalten eines Schalters in die Position „Ein“ beinhalten. - Änderungen speichern und anwenden: Nach dem Aktivieren von iSCSI stellen Sie sicher, dass Sie die Änderungen speichern. Es können zusätzliche Aufforderungen oder Schritte zur Bestätigung der Änderungen erforderlich sein, abhängig vom spezifischen NetApp-System und dessen Version.

Denken Sie daran, alle Voraussetzungen oder zusätzlichen Konfigurationseinstellungen zu prüfen, die für den iSCSI-Betrieb erforderlich sein könnten, wie z. B. Netzwerkeinstellungen, Lizenzierung oder Kompatibilitätsprüfungen der Hardware. Die genauen Schritte können je nach ONTAP-Version oder dem spezifischen NetApp-Modell, das Sie verwenden, leicht variieren. Beziehen Sie sich immer auf die neueste offizielle NetApp-Dokumentation oder Support-Ressourcen für die genaueste Anleitung.

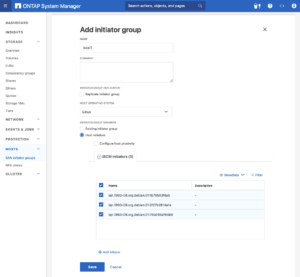

SAN-Initiatorgruppe erstellen

Navigieren Sie zum Menü HOSTS. Navigieren Sie dann zu SAN-Initiatorgruppen. Wählen Sie den spezifischen Initiatorgruppennamen aus, den Sie konfigurieren möchten:

- Host-Initiatoren konfigurieren: Suchen Sie auf jedem Proxmox VE-Knoten die Datei /etc/iscsi/initiatorname.iscsi und erfassen Sie den InitiatorName (iSCSI-Host-IQN). Fügen Sie jeden InitiatorName als Host-Initiatoren in der Initiatorgruppe im ONTAP System Manager hinzu.

- Änderungen speichern und anwenden: Nachdem Sie alle Initiatoren hinzugefügt haben, stellen Sie sicher, dass Sie die Änderungen speichern. Es können zusätzliche Aufforderungen oder Schritte zur Bestätigung der Änderungen erforderlich sein, abhängig vom spezifischen NetApp-System und dessen Version.

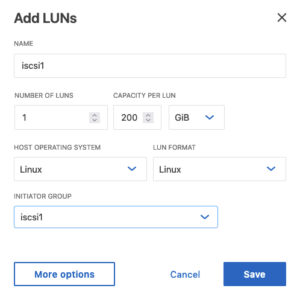

LUNs mit Initiatorgruppe erstellen

Navigieren Sie zum Menü Storage. Navigieren Sie dann zu LUNS. Wählen Sie den spezifischen LUN-Namen aus, den Sie konfigurieren möchten:

- LUNs hinzufügen: Geben Sie die Anzahl der LUNs an, die Sie konfigurieren möchten. Stellen Sie das Host-Betriebssystem auf Linux ein. Wählen Sie die im vorherigen Schritt erstellte Initiatorgruppe aus.

- Änderungen speichern und anwenden: Nachdem Sie LUNs hinzugefügt haben, stellen Sie sicher, dass Sie die Änderungen speichern. Es können zusätzliche Aufforderungen oder Schritte zur Bestätigung der Änderungen erforderlich sein, abhängig vom spezifischen NetApp-System und dessen Version.

Konfiguration des Proxmox VE-Knotens

Allgemein

Nach der Konfiguration der NetApp-Storage-Appliance für die Erstellung des iSCSI-Targets und der LUNs können wir nun den Proxmox VE-Cluster so konfigurieren, dass er den iSCSI-Speicher verwendet und darauf zugreift. Dies kann einfach über die Proxmox-Weboberfläche konfiguriert werden. Im Allgemeinen besteht dieser Prozess aus:

- Verbindung mit dem iSCSI-Blockspeicher herstellen.

- Erstellen eines LVM (Logical Volume Manager), das über Knoten auf Proxmox VE gemeinsam genutzt werden kann. Diese Anweisungen funktionieren jedoch wahrscheinlich auch auf älteren und neueren Versionen.

Die nächsten Schritte in diesem Blogbeitrag werden den Prozess im Detail behandeln und Sie durch die notwendigen Schritte auf dem Proxmox VE führen, die auf der Proxmox-Weboberfläche durchgeführt werden können.

Verbindung mit dem iSCSI-Blockspeicher herstellen

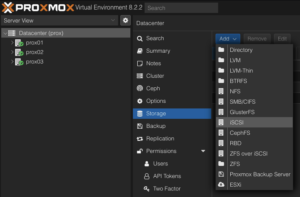

Um diesen iSCSI-Block Storage auf dem Proxmox VE-Cluster zu verwenden, führen Sie die folgenden Schritte aus, um sich am Web-Frontend des Proxmox VE-Clusters anzumelden und den Storage auf Datacenter-Ebene hinzuzufügen:

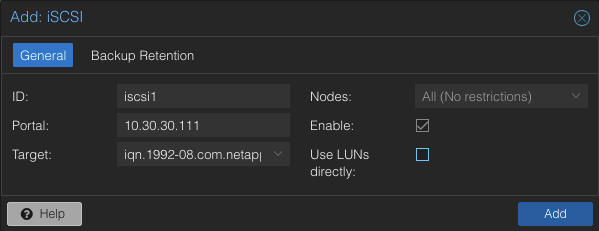

Navigieren Sie zur Speicherkonfiguration: Gehen Sie zu Datacenter -> Storage -> Add -> iSCSI.

Details des neuen iSCSI-Speichers definieren:

- ID: iscsi1 (dies kann beliebiger Text sein und ist lediglich ein Bezeichner).

- Portal: Geben Sie die IP-Adresse der iSCSI-fähigen SVM ein.

- Target: Dies wird erkannt, wenn Sie die korrekte IP für die iSCSI-fähige SVM angeben.

- Nodes: <Wählen Sie alle Knoten aus, die den iSCSI-Speicher verwenden sollen>

- Aktivieren: Ja

- LUNs direkt verwenden: Nein

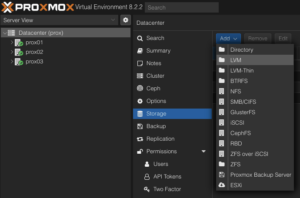

LVM auf dem iSCSI-Blockspeicher erstellen

Um diese LVM-Volume-Gruppe über iSCSI-Block Storage auf allen Proxmox VE-Knoten innerhalb des Clusters zu verwenden, muss die Volume-Gruppe auf Datacenter-Ebene hinzugefügt und integriert werden. Führen Sie diese Schritte aus, um sie über die Proxmox VE-Weboberfläche zu konfigurieren:

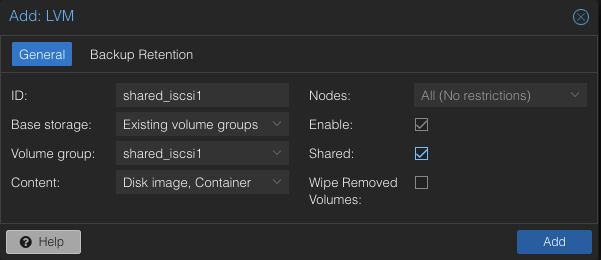

Navigieren Sie zur Speicherkonfiguration: Gehen Sie zu Datacenter -> Storage -> Add -> LVM.

Details des neuen LVM-Speichers definieren:

- ID: shared_iscsi1 (dies kann beliebiger Text sein und ist lediglich ein Bezeichner)

- Basisspeicher: Bestehende Volume-Gruppen

- Volume-Gruppe: shared_iscsi1

- Inhalt: Disk-Image, Container

- Knoten: <Wählen Sie alle Knoten aus, die es verwenden sollen>

- Aktiviert: Ja

- Freigegeben: Ja

- Entfernte Volumes löschen: Nein

Klicken Sie auf Hinzufügen, um das neue Volume an die ausgewählten Knoten anzuhängen. Der LVM-Speicher steht dann zur Verfügung.

Fazit

Die Nutzung von iSCSI über TCP in Verbindung mit Proxmox VE in einer Virtualisierungsumgebung stellt eine überzeugende Lösung für Unternehmen dar, die nach kostengünstigen Shared-Storage-Architekturen suchen. Dieser Ansatz nutzt die weitverbreitete Verfügbarkeit und Kompatibilität von Ethernet-basierten Netzwerken und vermeidet die Notwendigkeit spezieller Hardware wie Fibre Channel, die für viele Unternehmen kostspielig sein kann.

Block-Level-Storage mit SAN-Protokollen (FC/iSCSI/NVMe-oF) ist jedoch typischerweise auf die von Proxmox VE unterstützten VM-Disk- und Container-Image-Inhaltstypen beschränkt. Darüber hinaus werden Gast-VM-Snapshots und Thin Provisioning derzeit nicht unterstützt, wenn LVM/iSCSI-Storage in Proxmox VE verwendet wird.

Es gibt Alternativen, die NetApp-Storage ebenfalls bereitstellen kann, um die umfassenderen Anforderungen von Proxmox VE zu erfüllen. Die NAS-Protokolle, wie z. B. NFS, unterstützen alle Inhaltstypen von Proxmox VE und werden typischerweise einmalig auf Datacenter-Ebene konfiguriert. Gast-VMs können Festplatten vom Typ raw, qcow2 oder VMDK auf NAS-Protokoll-Storage verwenden. Darüber hinaus werden Gast-VM-Snapshots und Thin Provisioning mit dem qcow2-Format unterstützt.

Bei Bedarf stehen wir Ihnen gerne zur Verfügung, um Ihnen weitere Einblicke in NetApp-Storage-Systeme zu geben, die sowohl Hardware- als auch Softwareaspekte abdecken. Unsere Expertise erstreckt sich auch auf open source Produkte, insbesondere bei der Einrichtung von Virtualisierungsumgebungen mit Technologien wie Proxmox und OpenShift oder bei deren Wartung mit Konfigurationsmanagement. Wir laden Sie ein, sich bei Bedarf an uns zu wenden.

Sie könnten auch daran interessiert sein, zu erfahren, wie Sie VMs von VMware ESXi zu Proxmox VE migrieren oder wie Sie den Proxmox Backup Server einbinden und NetApp Storage und NVMe-oF für bahnbrechende Leistung in Proxmox-Virtualisierungsumgebungen in Ihre Infrastruktur integrieren können.

Dieser Artikel wurde ursprünglich von Andrew Lee verfasst.

DebConf 2024 vom 28. Juli bis 4. August 2024 https://debconf24.debconf.org/

Letzte Woche fand die jährliche Debian Community Conference DebConf in Busan, Südkorea, statt. Vier NetApp-Mitarbeiter (Michael, Andrew, Christop und Noël) nahmen die ganze Woche an der Pukyong National University teil. Das Camp findet vor der Konferenz statt, wo die Infrastruktur aufgebaut wird und die ersten Kooperationen stattfinden. Das Camp wird in einem separaten Artikel beschrieben: https://www.credativ.de/en/blog/credativ-inside/debcamp-bootstrap-for-debconf24/

Zu dieser Zeit herrschte in Korea eine Hitzewelle mit hoher Luftfeuchtigkeit, aber der Veranstaltungsort und die Unterkünfte an der Universität sind klimatisiert, so dass die Zusammenarbeit, Vorträge und BoF unter den gegebenen Umständen möglich waren.

Rund 400 Debian-Enthusiasten aus aller Welt waren vor Ort, und weitere Personen nahmen per Video-Streaming und dem Matrix-Online-Chat #debconf:matrix.debian.social aus der Ferne teil.

Das Content-Team erstellte einen Zeitplan mit verschiedenen Aspekten von Debian: technisch, sozial, politisch, ….

https://debconf24.debconf.org/schedule/

Während der DebConf24 gab es zwei größere Ankündigungen:

- die neue Distribution eLxr https://elxr.org/ basierend auf Debian, initiiert von Windriver

https://debconf24.debconf.org/talks/138-a-unified-approach-for-intelligent-deployments-at-the-edge/

Zwei wichtige Punkte, die ich aus diesem Vortrag mitgenommen habe, sind, dass Windriver CentOS austauschen möchte und eine binäre Distribution bevorzugt. - Das Debian-Paketverwaltungssystem erhält einen neuen Solver https://debconf24.debconf.org/talks/8-the-new-apt-solver/

Die Liste der interessanten Vorträge aus einer ganzen Konferenzwoche ist noch viel länger. Die meisten Vorträge und BoF wurden live gestreamt und die Aufzeichnungen sind im Videoarchiv zu finden:

https://meetings-archive.debian.net/pub/debian-meetings/2024/DebConf24/

Es ist Tradition, einen Tagesausflug zur Kontaktpflege zu machen und einen interessanteren Blick auf die Stadt und das Land zu bekommen. https://wiki.debian.org/DebConf/24/DayTrip/ (Entschuldigung, die Details der drei Tagesausflüge sind auf der Website für Teilnehmer).

Für das jährliche Gruppenfoto müssen wir ins Freie in die Hitze mit hoher Luftfeuchtigkeit gehen, aber ich hoffe, Sie werden uns nicht schwitzen sehen.

Die Debian Konferenz 2025 findet im Juli in Brest, Frankreich, statt: https://wiki.debian.org/DebConf/25/ und wir werden dabei sein. 🙂 Vielleicht ist es eine Chance für Sie, sich uns anzuschließen.

Siehe auch Debian News: DebConf24 schließt in Busan und DebConf25-Termine angekündigt