Proxmox ZFS vs. LVM vs. Ceph: Storage-Entscheidung

| Kategorien: | credativ® Inside Proxmox |

|---|---|

| Tags: | Ceph LVM proxmox Proxmox VE ZFS |

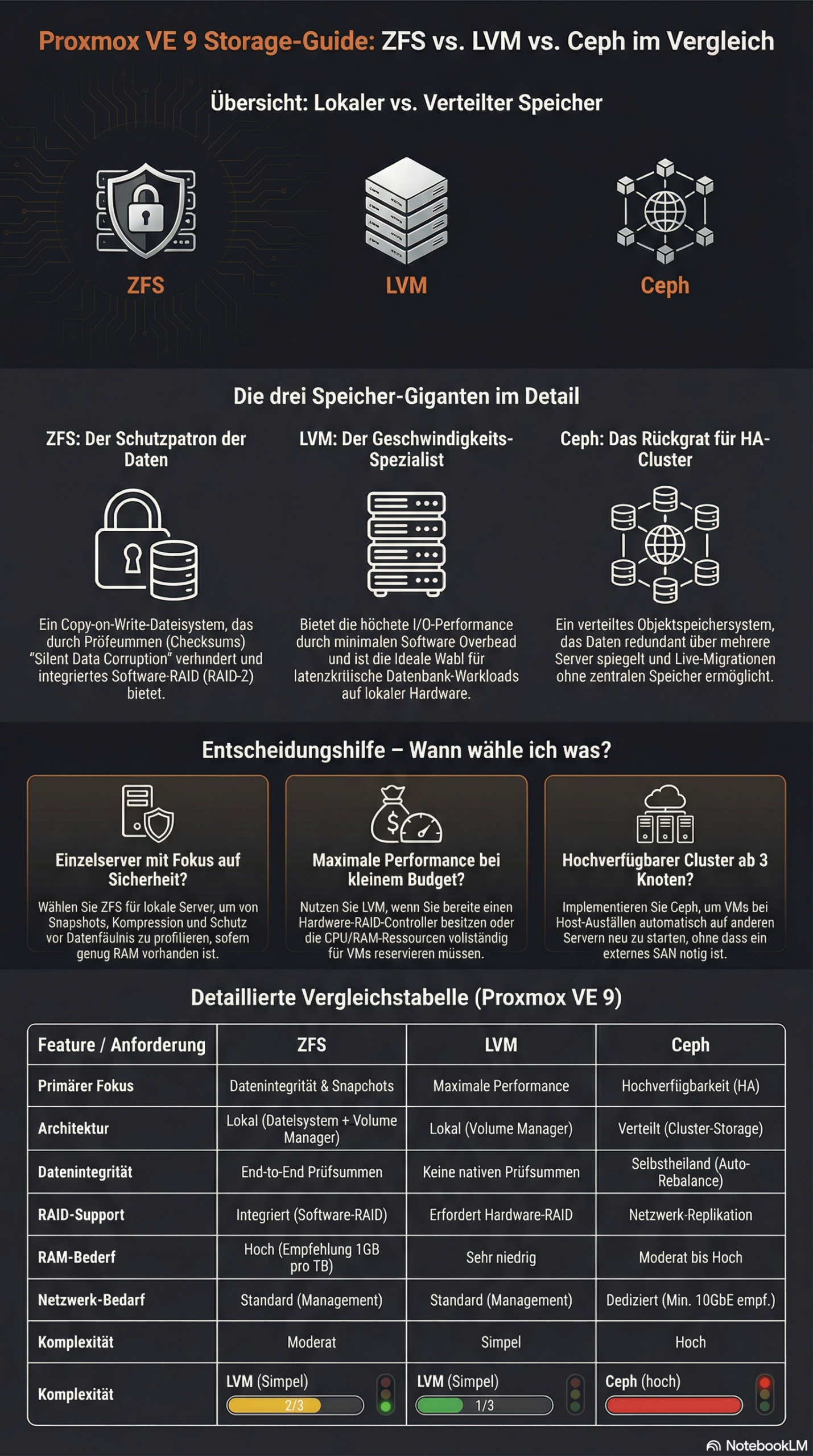

Die Wahl zwischen ZFS, LVM und Ceph in Proxmox hängt von Ihren spezifischen Anforderungen ab. ZFS bietet integrierte Datenredundanz und Snapshots für lokale Systeme, LVM ermöglicht flexible Volume-Verwaltung mit hoher Performance, während Ceph verteilte Storage-Lösungen für Cluster-Umgebungen bereitstellt. Jede Technologie hat unterschiedliche Stärken bei Performance, Skalierbarkeit und Wartungsaufwand.

Was ist der Unterschied zwischen ZFS, LVM und Ceph in Proxmox?

ZFS ist ein Copy-on-Write-Dateisystem mit integrierter Volume-Verwaltung und Datenredundanz. Es kombiniert Dateisystem und Volume-Manager in einer Lösung und bietet Features wie Snapshots, Komprimierung und automatische Fehlerkorrektur. ZFS eignet sich besonders für lokale Storage-Szenarien mit hohen Anforderungen an die Datenintegrität.

LVM (Logical Volume Manager) arbeitet als Abstraktionsschicht zwischen physischen Festplatten und dem Dateisystem. Es ermöglicht flexible Partitionierung und dynamische Volume-Größenänderungen zur Laufzeit. LVM bietet hohe Performance und einfache Verwaltung, benötigt jedoch zusätzliche Redundanzmechanismen wie Software-RAID.

Ceph stellt eine vollständig verteilte Storage-Architektur dar, die Daten über mehrere Knoten repliziert. Es bietet Object-, Block- und File-Storage in einem System und skaliert horizontal. Ceph eignet sich für große Cluster-Umgebungen mit hohen Anforderungen an die Verfügbarkeit.

Welche Storage-Lösung bietet die beste Performance für verschiedene Workloads?

LVM mit ext4 oder XFS liefert die höchste Performance für I/O-intensive Anwendungen wie Datenbanken. Der geringe Overhead macht es zur ersten Wahl für latenzkritische Workloads. ZFS folgt mit guter Performance bei gleichzeitigen Datenintegritäts-Features, während Ceph durch Netzwerk-Overhead höhere Latenz aufweist.

Für Datenbank-Workloads empfiehlt sich LVM mit schnellen SSDs und direktem Zugriff. Die minimale Abstraktionsschicht reduziert Latenz und maximiert IOPS. ZFS kann hier durch ARC-Cache und L2ARC-Beschleunigung konkurrenzfähige Performance bieten, besonders bei read-lastigen Workloads.

File-Services profitieren von ZFS-Features wie Deduplizierung und Komprimierung, die Speicherplatz sparen.

Ceph eignet sich für verteilte File-Services mit hohen Anforderungen an die Verfügbarkeit, auch wenn die Performance durch Netzwerkommunikation begrenzt wird. Hier lassen sich virtuelle Maschinen praktisch ohne großen Zeitverzug von Host zu Host migrieren, sei es durch ein Tool wie ProxLB oder auch im Fail-Over-Fall,

Virtuelle Maschinen laufen auf allen drei Systemen gut. LVM bietet die beste Roh-Performance, ZFS ermöglicht effiziente VM-Snapshots, und Ceph bietet Live-Migration zwischen Hosts ohne gemeinsamen Storage.

| Feature | LVM | ZFS | Ceph |

|---|---|---|---|

| Architektur-Typ | Lokal (Block-Storage) | Lokal (Dateisystem & Volume Manager) | Verteilt (Object/Block/File) |

| Performance (Latenz) | Exzellent (Minimaler Overhead) | Gut (Skaliert mit RAM/ARC) | Moderat (Abhängig vom Netzwerk) |

| Snapshots | Ja | Ja (sehr effizient) | Ja |

| Datenintegrität | Begrenzt (RAID-abhängig) | Exzellent (Checksumming) | Exzellent (Checksumming) |

| Skalierbarkeit | Begrenzt (Single Node) | Medium (innerhalb des Hosts) | Sehr hoch (Horizontal im Cluster) |

| Netzwerk-Anforderung | Standard (1 GbE ausreichend) | Standard (1 GbE ausreichend) | Hoch (min. 10-25 GbE empfohlen) |

| Haupteinsatzgebiet | Maximale Single-Node Performance | Hohe Datensicherheit & Lokaler Speed | Enterprise Cluster & High Availability |

| Komplexität | Einfach | Moderat | Hoch |

Wie entscheidet man zwischen lokaler und verteilter Storage-Architektur?

Lokale Storage-Lösungen wie ZFS und LVM eignen sich für Single-Host-Umgebungen oder wenn maximale Performance wichtiger ist als Hochverfügbarkeit. Verteilte Systeme wie Ceph sind notwendig, wenn Daten über mehrere Hosts verfügbar sein müssen oder automatische Failover-Mechanismen erforderlich sind.

Die Infrastrukturgröße spielt eine entscheidende Rolle. Einzelne Proxmox-Hosts oder kleine Setups mit zwei bis drei Servern funktionieren gut mit lokalen Storage-Lösungen. Ab drei bis vier Hosts wird Ceph interessant, da es echte Hochverfügbarkeit ohne Single Point of Failure ermöglicht. Ceph erfordert ein Quorum, sodass immer eine ungerade Anzahl an Knoten für Ceph bereit steht. Cluster-Setups mit einer geraden Anzahl sind also immer mit einer gewissen unterschiedlichen Nutzung behaftet - aber hier muss auch bei Proxmox VE Hand angelegt werden.

Netzwerkanforderungen unterscheiden sich erheblich. Lokale Storage-Systeme benötigen nur Standardnetzwerk für das Management, während Ceph dedizierte 10GbE-Verbindungen für optimale Performance erfordert. Heute setzt man ab einem gewissen Performance-Bedarf eher auf 25GbE-Verbindungen für die Datenllast. Diese Verbindungen stehen dann im Idealfall nur dem Ceph-System zur Verfügung und kommen zusätzlich zum Bedarf der Virtualisierung. Die Netzwerk-Infrastruktur beeinflusst daher maßgeblich die Storage-Entscheidung.

Wartungsaufwand und Komplexität steigen mit verteilten Systemen. ZFS und LVM sind einfacher zu verstehen und zu warten, während Ceph spezialisiertes Wissen für Konfiguration, Monitoring und Troubleshooting erfordert.

Proxmox VE mit ZFS bietet mit pe-sync einen Mittelweg zwischen echtem Shared Storage und lokaler Datenhaltung. Hiermit kann man automatisch Hosts miteinander in Sync halten. Allerdings ist dies nicht synchron sondern in bestimmten Zeitintervallen, etwa alle 15 Minuten. Für bestimmte Arbeitslasten kann dies absolut hinreichend sein.

Was sind die wichtigsten Faktoren bei der Proxmox-Storage-Planung?

Hardware-Anforderungen variieren stark zwischen den Storage-Technologien. ZFS benötigt ausreichend RAM (1 GB pro TB Storage), damit der integrierte ARC-Cache seine Leistung voll ausspielen kann, LVM läuft auf minimaler Hardware, und Ceph erfordert dedizierte Netzwerk-Hardware, ebenfalls ausreichend RAM und mehrere Hosts. Die Hardware-Ausstattung bestimmt oft die möglichen Storage-Optionen.

Backup-Strategien müssen zur gewählten Storage-Lösung passen. ZFS-Snapshots ermöglichen effiziente inkrementelle Backups, LVM-Snapshots bieten ähnliche Funktionalität, während Ceph-Backups über RBD-Snapshots oder externe Tools realisiert werden. Die Backup-Anforderungen beeinflussen die Storage-Wahl erheblich.

Skalierbarkeitsplanung sollte zukünftiges Wachstum berücksichtigen. LVM ermöglicht einfache Volume-Erweiterung, ZFS-Pools können um zusätzliche Laufwerke erweitert werden, und Ceph skaliert durch Hinzufügen neuer Hosts. Die geplante Wachstumsrichtung beeinflusst die optimale Storage-Architektur.

Budgetüberlegungen umfassen nicht nur Hardware-Kosten, sondern auch Wartungsaufwand und benötigte Expertise. Einfache LVM-Setups haben niedrige Gesamtkosten, während Ceph-Cluster höhere Investitionen in Hardware und Schulungen erfordern.

Bonus: ZFS und Ceph bieten beide integrierte Prüfsummenverfahren, die aktiv gegen den sogenannten "Bit Rot" - die schleichende Datenkorruption - helfen und diesen durch Redundanz automatisch erkennen und beheben können. Bei LVM ohne weitere Zusätze wie ein RAID-Layer erlaubt dies nicht.

Wie credativ® bei der Proxmox-Storage-Optimierung unterstützt

credativ® bietet umfassende Beratung und Implementierung für optimale Proxmox-Storage-Entscheidungen basierend auf Ihren spezifischen Anforderungen. Unsere Open-Source-Experten analysieren Ihre Workloads, Infrastruktur und Wachstumspläne, um die ideale Storage-Architektur zu empfehlen.

Unsere Services umfassen:

- Detaillierte Storage-Architektur-Bewertung und Technologieauswahl

- Professionelle Implementierung und Konfiguration von ZFS, LVM oder Ceph

- Performance-Optimierung und Monitoring-Setup für gewählte Storage-Lösungen

- 24/7-Support und Wartung für produktive Proxmox-Umgebungen

- Schulungen für Ihr IT-Team zu Storage-Management und Best Practices

Mit über 25 Jahren Erfahrung im Open-Source-Bereich und direktem Zugang zu unseren festangestellten Linux-Spezialisten erhalten Sie professionelle Proxmox-Unterstützung ohne Umwege über Callcenter. Kontaktieren Sie uns für eine individuelle Beratung zu Ihrer Proxmox-Storage-Strategie und profitieren Sie von unserem bewährten Enterprise-Support.

| Kategorien: | credativ® Inside Proxmox |

|---|---|

| Tags: | Ceph LVM proxmox Proxmox VE ZFS |

über den Autor

Peter Dreuw

Head of Sales & Marketing

zur Person

Peter Dreuw arbeitet seit 2016 für die credativ GmbH und ist seit 2017 Teamleiter. Seit 2021 ist er Teil des Management-Teams als VP Services der Instaclustr. Mit der Übernahme durch die NetApp wurde seine neue Rolle "Senior Manager Open Source Professional Services". Im Rahmen der Ausgründung wurde er Mitglied der Geschäftsleitung als Prokurist. Sein Aufgabenfeld ist die Leitung des Vertriebs und des Marketings. Er ist Linux-Nutzer der ersten Stunden und betreibt Linux-Systeme seit Kernel 0.97. Trotz umfangreicher Erfahrung im operativen Bereich ist er leidenschaftlicher Softwareentwickler und kennt sich auch mit hardwarenahen Systemen gut aus.